Valstybės remiami įsilaužėliai naudoja Google Gemini AI modelį, kad palaikytų visus atakos etapus – nuo žvalgybos iki veiksmų po kompromiso.

Blogi aktoriai iš Kinijos (APT31, Temp.HEX), Irano (APT42), Šiaurės Korėjos (UNC2970) ir Rusijos naudojo „Gemini“ taikinių profiliavimui ir atvirojo kodo žvalgybai, sukčiavimo vilionių generavimui, teksto vertimui, kodavimui, pažeidžiamumo tikrinimui ir trikčių šalinimui.

Kibernetiniai nusikaltėliai taip pat rodo didesnį susidomėjimą dirbtinio intelekto įrankiais ir paslaugomis, kurios gali padėti vykdyti nelegalią veiklą, pavyzdžiui, socialinės inžinerijos ClickFix kampanijas.

AI patobulinta kenkėjiška veikla

„Google Threat Intelligence Group“ (GTIG) šiandien paskelbtoje ataskaitoje pažymi, kad APT priešai naudoja „Gemini“ savo kampanijoms palaikyti „nuo žvalgybos ir sukčiavimo vilionių kūrimo iki komandų ir kontrolės (C2) kūrimo ir duomenų išfiltravimo“.

Kinijos grėsmės veikėjai pasamdė kibernetinio saugumo ekspertą, kad paprašytų, kad „Gemini“ automatizuotų pažeidžiamumo analizę ir pateiktų tikslinius testavimo planus pagal sukurtą scenarijų.

„KLR pagrįstas grėsmės veikėjas sukūrė scenarijų, vienu atveju išbandydamas Hexstrike MCP įrankius ir nukreipdamas modelį analizuoti nuotolinio kodo vykdymo (RCE), WAF apėjimo metodus ir SQL įpurškimo testų rezultatus, palyginti su konkrečiais JAV taikiniais“, – teigia „Google“.

Kitas Kinijoje įsikūręs aktorius dažnai samdydavo „Gemini“, kad taisytų savo kodą, atliktų tyrimus ir patartų dėl techninių įsibrovimų galimybių.

Irano priešas APT42 panaudojo Google LLM socialinės inžinerijos kampanijoms, kaip kūrimo platformą, siekdamas paspartinti pritaikytų kenkėjiškų įrankių kūrimą (derinimo, kodo generavimo ir išnaudojimo metodų tyrimo).

Buvo pastebėtas papildomas grėsmės veikėjų piktnaudžiavimas diegiant naujas galimybes esamose kenkėjiškų programų šeimose, įskaitant „CoinBait“ sukčiavimo rinkinį ir „HonestCue“ kenkėjiškų programų atsisiuntimo ir paleidimo priemonę.

GTIG pažymi, kad didelių proveržių šiuo atžvilgiu neįvyko, nors technologijų milžinas tikisi, kad kenkėjiškų programų operatoriai ir toliau integruos dirbtinio intelekto galimybes į savo įrankių rinkinius.

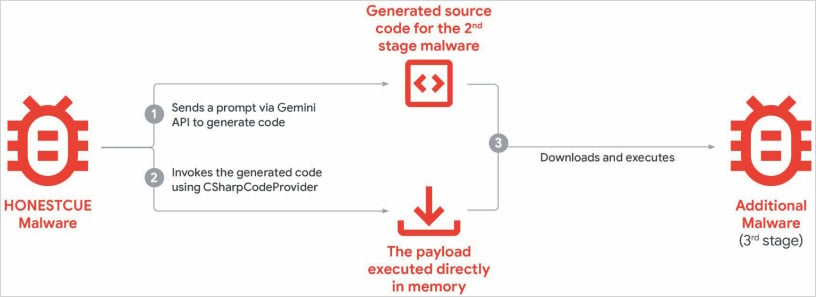

„HonestCue“ yra kenkėjiškų programų koncepcijos įrodymo sistema, pastebėta 2025 m. pabaigoje, kuri naudoja „Gemini“ API, kad sugeneruotų antrosios pakopos kenkėjiškų programų C# kodą, tada sukompiliuoja ir vykdo naudingąsias apkrovas atmintyje.

Šaltinis: Google

„CoinBait“ yra „React SPA“ supakuotas sukčiavimo rinkinys, slepiamas kaip kriptovaliutos keitimo priemonė kredencialams rinkti. Jame yra artefaktų, rodančių, kad jo kūrimas buvo patobulintas naudojant AI kodo generavimo įrankius.

Vienas iš LLM naudojimo rodiklių yra pranešimų registravimas kenkėjiškų programų šaltinio kode su priešdėliu „Analytics:“, kuris galėtų padėti gynėjams sekti duomenų išfiltravimo procesus.

Remdamiesi kenkėjiškų programų pavyzdžiais, GTIG mokslininkai mano, kad kenkėjiška programa buvo sukurta naudojant „Lovable AI“ platformą, nes kūrėjas naudojo „Lovable Supabase“ klientą ir lovable.app.

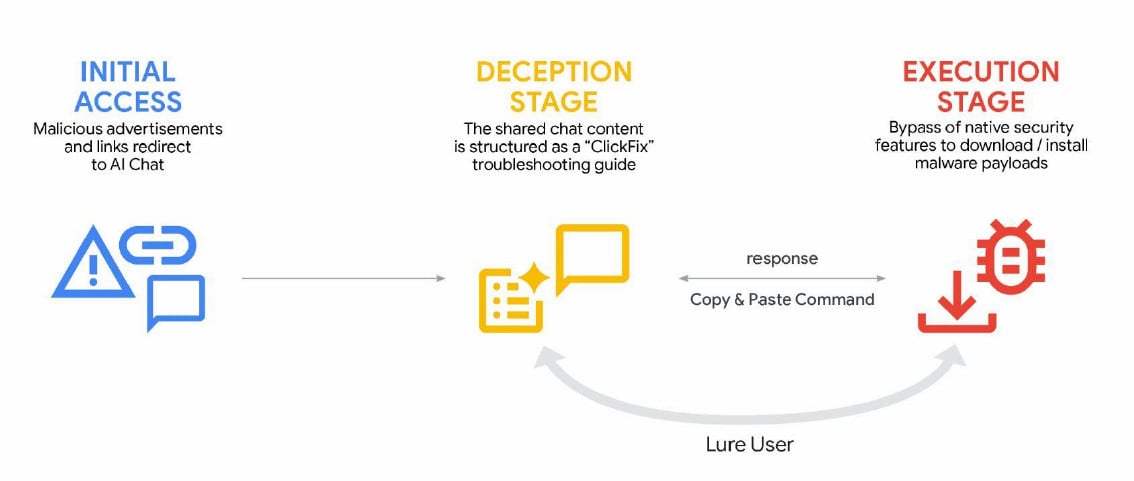

Kibernetiniai nusikaltėliai taip pat naudojo generatyviąsias AI paslaugas „ClickFix“ kampanijose, pristatydami AMOS informaciją vagiančią kenkėjišką programą „MacOS“. Naudotojai buvo suvilioti vykdyti kenkėjiškas komandas per kenkėjiškus skelbimus, pateiktus paieškos rezultatuose, siekiant užklausų dėl konkrečių problemų šalinimo.

šaltinis: Google

Ataskaitoje taip pat pažymima, kad Dvyniai susidūrė su AI modelio išgavimo ir distiliavimo bandymais, o organizacijos pasinaudojo įgaliota API prieiga, kad galėtų metodiškai atlikti sistemos užklausas ir atkurti jos sprendimų priėmimo procesus, kad atkartotų jos funkcijas.

Nors ši problema nekelia tiesioginės grėsmės šių modelių naudotojams ar jų duomenims, ji yra rimta komercinė, konkurencinė ir intelektinės nuosavybės problema šių modelių kūrėjams.

Iš esmės aktoriai ima informaciją, gautą iš vieno modelio, ir perduoda informaciją kitam, naudodami mašininio mokymosi techniką, vadinamą „žinių distiliavimu“, kuri naudojama naujiems modeliams iš pažangesnių modelių mokyti.

„Modelio išgavimas ir vėlesnis žinių distiliavimas leidžia užpuolikui greitai ir žymiai mažesnėmis sąnaudomis paspartinti AI modelio kūrimą“, – teigia GTIG mokslininkai.

„Google“ pažymi šias atakas kaip grėsmę, nes jos yra intelektualinė vagystė, jos yra keičiamos ir labai kenkia AI kaip paslaugos verslo modeliui, kuris gali greitai paveikti galutinius vartotojus.

Per didelio masto tokio pobūdžio ataką Gemini AI buvo nukreiptas į 100 000 raginimų, kurie iškėlė daugybę klausimų, kuriais buvo siekiama pakartoti modelio samprotavimus atliekant įvairias užduotis ne anglų kalbomis.

„Google“ išjungė paskyras ir infrastruktūrą, susietas su dokumentais pagrįstu piktnaudžiavimu, ir įdiegė tikslines apsaugos priemones „Gemini“ klasifikatoriuose, kad piktnaudžiavimas būtų sunkesnis.

Bendrovė patikina, kad ji „kuria AI sistemas su tvirtomis saugumo priemonėmis ir tvirtais apsauginiais turėklais“ ir reguliariai tikrina modelius, kad pagerintų jų saugumą ir saugą.

Šiuolaikinė IT infrastruktūra juda greičiau, nei gali atlikti rankinės darbo eigos.

Šiame naujajame „Tines“ vadove sužinokite, kaip jūsų komanda gali sumažinti paslėptus rankinius delsus, pagerinti automatinio atsako patikimumą ir sukurti bei išplėsti intelektualias darbo eigas su jau naudojamais įrankiais.